1320亿参数,性能超LLaMA2、Grok-1!开源大模型DBRX正式上线!

来源:AICG工具箱 责编:网络 时间:2025-04-18 12:26:44

3月28日,著名数据和AI平台Databricks在官网正式开源大模型——DBRX。

DBRX是一个专家混合模型(MoE)有1320亿参数,能生成文本/代码、数学推理等,有基础和微调两种模型。

根据DBRX在MMLU、HumanEval和 GSM8K公布的测试数据显示,不仅性能超过了LLaMA2-70B和马斯克最近开源的Grok-1.推理效率比LLaMA2-70B快2倍,总参数却只有Grok-1的三分之一,是一款功能强算力消耗低的大模型。

基础模型:https://huggingface.co/databricks/dbrx-base

微调模型:https://huggingface.co/databricks/dbrx-instruct

Github:https://github.com/databricks/dbrx

在线demo:https://huggingface.co/spaces/databricks/dbrx-instruct

Databricks作为数据管理领域的超级独角兽,为了抓住生成式AI的风口,2023年6月26日曾以13亿美元的天价,收购了大模型开源平台MosaicML。

MosaicML曾在2023年5月5日发布了类ChatGPT开源大语言模型MPT-7B。(开源地址:https://huggingface.co/mosaicml/mpt-7b)该项目具备可商业化、高性能、算力消耗低、1T训练数据等技术优势。

MPT-7B只进行了大约10天的训练,零人工干预,训练成本仅用了20万美元。性能却打败了LLaMA-7B、StablelM-7B 、Cerebras-13B等当时知名开源模型。

截至目前,MPT-7B的下载量已超过300万次,而Databricks此次发布的DBRX在MPT-7B基础之上进行了大幅度优化并且将算力需求降低了4倍。

DBRX简单介绍

DBRX是一款基于Transformer的MoE架构大模型,1320亿参数中的360亿参数处于长期激活状态。

这与其它开源的MoE类型模型如Mixtral、Grok-1相比,DBRX使用了数量更多的小专家模型。DBRX有16个专家并选择4个,而Mixtral和Grok-1有8个专家并选择了2个。

DBRX使用了12T的文本和代码数据(支持中文),支持 32k上下文窗口,并在3072 个 英伟达的 H100 上进行了3个月的预训练。

DBRX除了与开源模型进行了对比之外,还与OpenAI的GPT系列、谷歌的Gemini以及Anthropic最新发布的Claude 3系列进行了同台竞技。

MMLU、HellaSwag、WinoGrande、HumanEval等综合测试结果显示,DBRX推理、数学解答、语言理解、代码等能力超过了GPT-3.5.性能与谷歌的Gemini 1.0 Pro 性能差不多。

什么是专家混合模型

MoE模型全称为Mixture of Experts,其核心原理是将一个庞大的神经网络分解为多个相对独立的小型子网络(即专家),每个专家负责处理输入数据的某些方面。

这种架构设计使得MoE模型能够高效利用计算资源,避免对所有参数进行无谓的计算。主要包括门控制机制、专家网络和聚合器三大模块

门控机制:这是MoE模型的核心模块,负责决定每个输入应该由哪个或哪几个专家处理。

门控机制会根据输入数据的特征分配权重给不同的专家,这个过程是动态的,意味着不同的输入会根据其内容被分配给最合适的专家处理。例如,Grok-1模型中只有大约25%的参数被实际使用或“激活”。

专家网络:这些是模型中的子网络,每个都有自己特定的参数配置。在传统的MoE模型中,这些专家网络可以是结构相同但参数不同的多个神经网络。每个网络都专注于模型任务的一个方面或输入数据的一个子集。

聚合器:一旦各个专家给出了自己对于输入的处理结果,聚合器则负责将这些结果综合起来,形成最终的输出。聚合的方式可以是简单的加权和、投票机制或者更复杂的融合策略。

MoE是开发、训练超过千亿参数大模型常用的架构,例如,GPT-4、Palm 2等著名大模型使用的都是该架构。

关于Databricks

Databricks创立于2013年,总部位于美国旧金山,在全球多个国家、地区设有办事处。其企业客户超过10000家,包括众多财富500强企业。

Databricks主要提数据智能分析服务,帮助企业、个人用户快速挖掘数据的商业价值。

- 常用AI 共 188 款

- 工具箱 共 218 款

- 最新消息 共 980 款

-

B端设计教学_怎么进行UI视觉设计_B端设计教学

相信广大设计师朋友在工作中总会遇到一些B端类的视觉需求,通常是UI的装饰氛围模块以及UI视觉卡片。今天我们就来个小教程,帮助大家快速了解这类需求的设计方法和制作过程。

-

中文多模态大模型SuperCLUE-V榜单发布丨Stability AI推出Stable Fast 3D模型丨Meta AI向好莱坞明星采买声音授权

【AI奇点网2024年8月5日早报】本站每日播报AI业界最新资讯,触摸时代脉搏,掌握未来科技动向。事不宜迟,点击查看今日AI资讯早餐。

-

阿里云发布通义千问2.5大模型:号称多项能力赶超GPT-4,发布开源模型Qwen1.5-110B

阿里云 AI 智领者峰会-北京站活动中,阿里云对外发布了新版的通义千问大模型,V2 5版本大模型正式发布,该版大模型的多项能力赶超了GPT-4。

-

全网沸腾!AI大模型「开源之王」Llama 3正式发布:性能比肩GPT-4

硅谷AI大厂Meta官网上新,官宣Llama 3正式发布。提供80亿和700亿参数两个版本。有意思的是,80亿版本在某些测评项目的成绩上还超过了70亿版本。

-

B端设计教学_怎么进行UI视觉设计_B端设计教学

35 2025-01-16

-

AI绘画教程_怎么用AI创作多角度人像_多角度人像_人物多角度

14 2025-01-16

-

ChatGPT如何工作_ChatGPT如何进行多轮对话

9 2025-01-26

-

小米AI助理“小爱同学”接入字节跳动豆包大模型,将用于小米旗下所有「人车家」终端

4 2025-02-24

-

基准测评国内第一:百川智能发布新一代大模型Baichuan 4,发布旗下首款AI智能搜索助理「百小应」

5 2025-03-26

-

谷歌Gemini引发争议!网友质疑宣传片疑似剪辑效果 夸大宣传丨实测对标GPT-4测评基准有失偏颇

24 2024-12-30

-

Music To Image音生图工具是什么_AI音频生成图像工具有哪些_AI音生图工具有哪些_Music To Image怎么用

11 2025-01-06

-

controlnet怎么操作_stable diffusion模型拆解_controlnet控图的差异跟使用技巧有哪些

11 2025-01-16

-

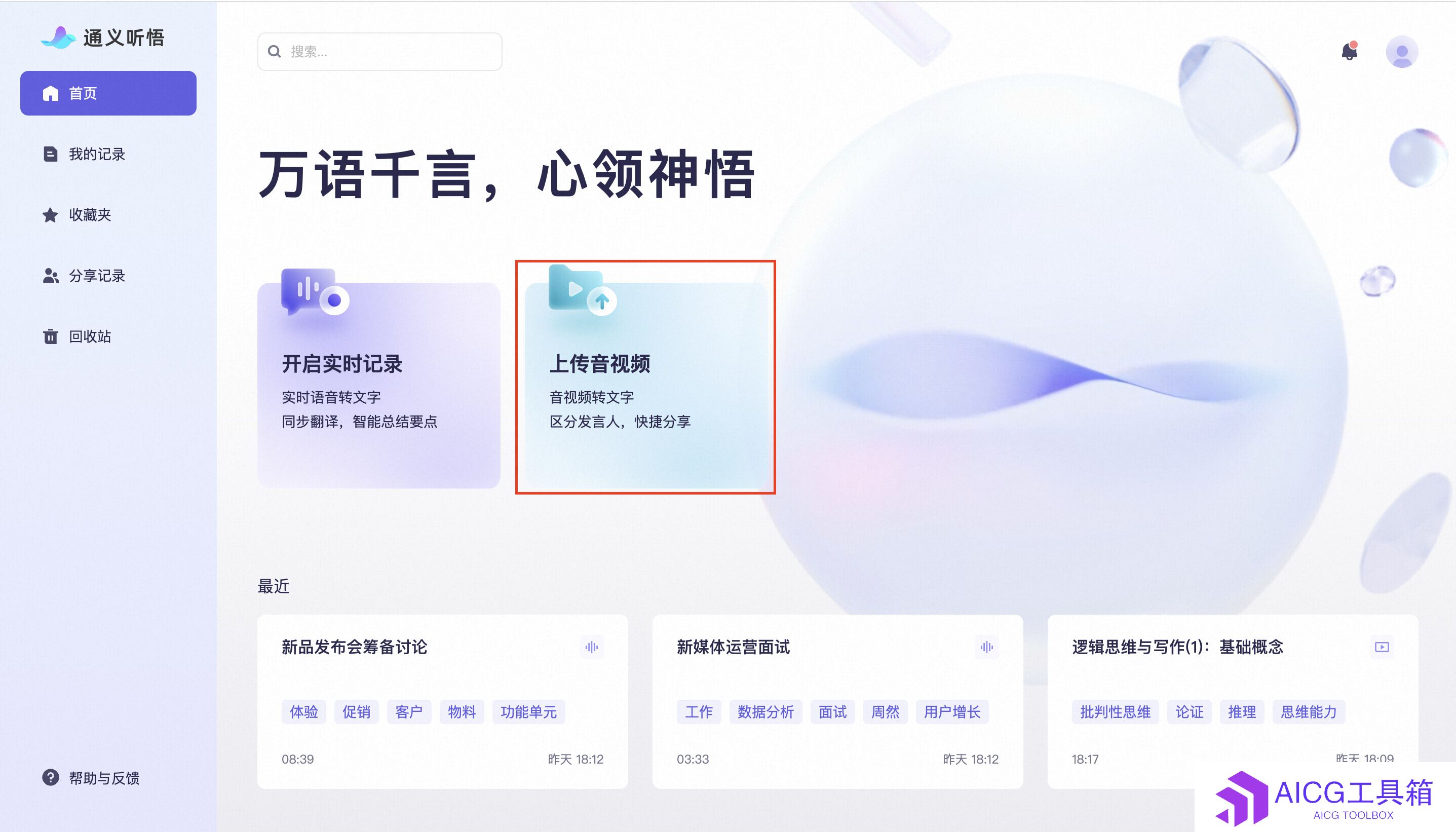

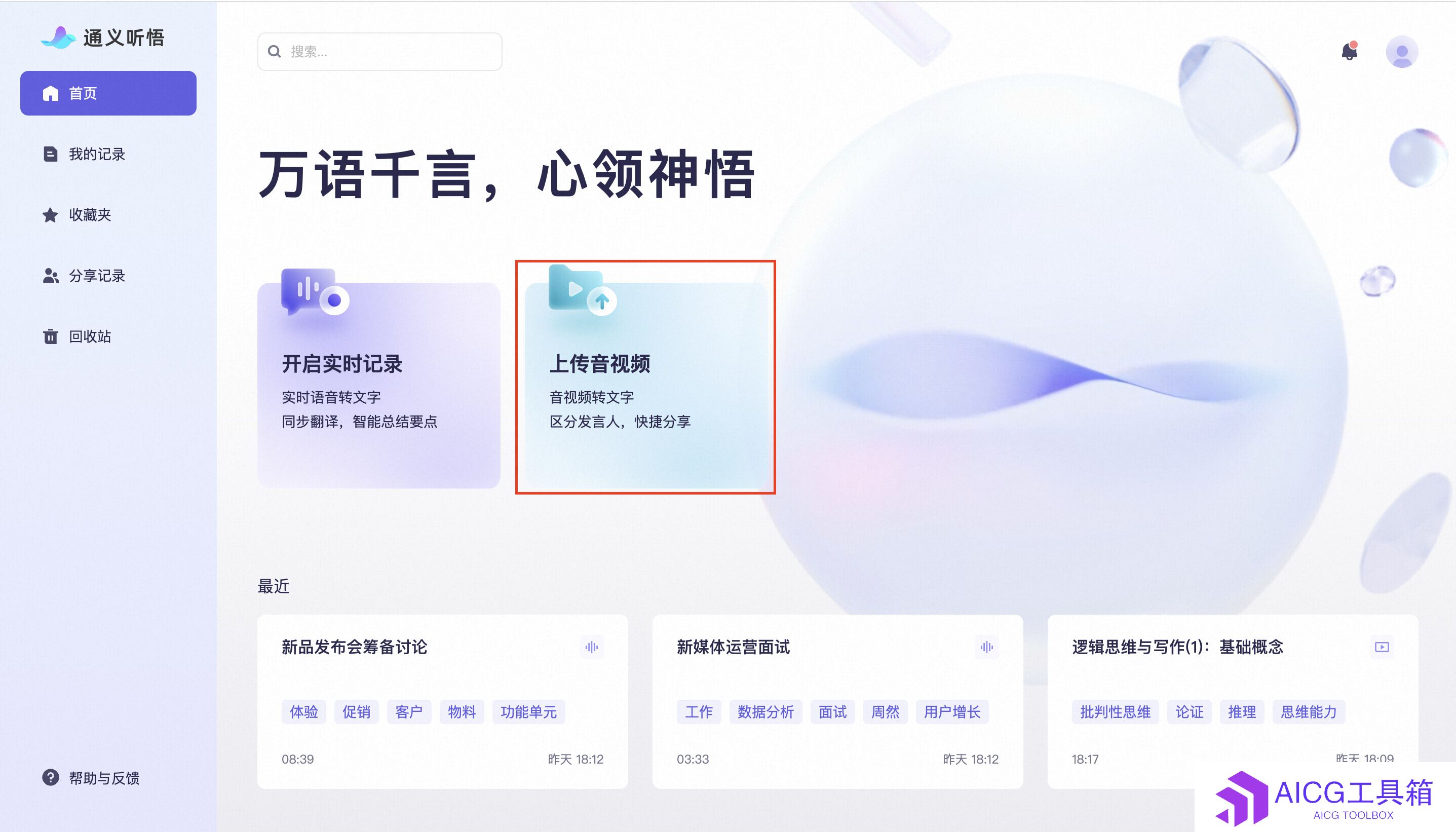

通义听悟如何将阿里云盘文件转文字

8 2025-01-23

-

stable diffusion图生图技巧_stable diffusion怎么图生图

8 2025-01-26